Che cosa sta succedendo alla gran massa degli utenti – ma sarebbe più opportuno parlare qui di cittadini, perché il problema interessa tutti – sempre più coinvolta dalla trasformazione digitale delle proprie vite? E sono le stesse vittime, un passo alla volta, a far sì questo cambiamento sia sempre più presente nel quotidiano.

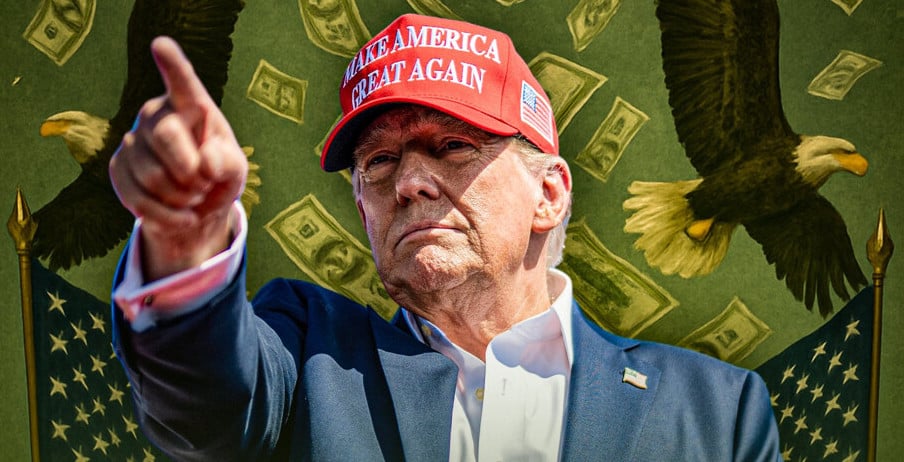

Prendiamo il caso dei deep fake video, oggi sulla bocca di tutti per il celebre ‘falso’ dell’arresto in diretta di Barak Obama rilanciato da Donald Trump sul social Truth, di sua proprietà. Non è certamente il primo, è solo il più recente, e lo stesso Trump aveva già sofferto per la diffusione di video artefatti a lui contrari (diffusi da Eliot Higgins, fondatore di Bellingcat, in occasione della sua incriminazione – vera questa volta – per il caso del pagamento alla pornostar Stormy Daniels, asseritamente effettuato con i fondi raccolti per la campagna elettorale.

Fake video sempre più difficili da scoprire

Ma il fatto è che questi video sono sempre più facili da creare grazie all’AI e sempre più difficili da scoprire, e trovano nei social, in tutti i social, una cassa di risonanza globale, mentre il numero di coloro che controllano la veridicità della affermazioni è in drastica, costante riduzione. La loro capacità di influenzare l’opinione corrente è pertanto enorme, e non sorprende che il loro uso si diffonda esponenzialmente.

I deepfake possono essere usati per distorcere la realtà, diffondere disinformazione e manipolare l’opinione pubblica, soprattutto in vista di elezioni o decisioni politiche cruciali. Possono far dire o fare a politici e figure istituzionali cose che non hanno mai detto o fatto, influenzando il voto e la percezione pubblica delle loro figure. Vengono impiegati per creare falsi scandali, diffamare avversari politici e distruggere la reputazione di figure pubbliche e istituzioni, minando la loro credibilità.

In contesti più fragili, come nazioni in via di sviluppo con minori sistemi di controllo, i deepfake possono persino mettere a rischio la stabilità di un paese, come accaduto in passato, nel 2023, con i video (falsi?) diffusi in Gabon che ritraevano il Presidente Ali Bongo Ondimba fare gli auguri di Capodanno che hanno scatenato instabilità politica nel paese e hanno portato alla sua deposizione a opera di una colpo di stato militare, con l’ombra incombente della PMC Wagner sullo sfondo.

Oltre alla politica, i deepfake sono usati anche in frodi bancarie (ad esempio, aggirando i sistemi di verifica dell’identità) e in altre forme di cybercrime: ad esempio un recente deepfake vocale del Ministro della Difesa Guido Crosetto ha ingannato imprenditori e altri operatori economici, evidenziando la vulnerabilità nazionale anche a livello istituzionale e ha portato all’apertura di un’inchiesta, destinata con ogni probabilità a sfociare in un nulla di fatto.

La smania della condivisione alla base del fenomeno

La pulsione a condividere immediatamente è irrefrenabile, e la viralità di questi video/audio è un dato di fatto. Non si tratta qui di ‘roba politica’, di scarso interesse – con sparute eccezioni – per le generazioni più giovani. Si tratta di come i social abbiamo marcato in maniera imprescindibile le nostre vite, al punto che spesso non ci facciamo più neppure caso. Basti pensare alle fotografie diffuse, non si sa ancora da chi, della morte di Patricia Masithela, la donna sbranata da cani a Latina, che i sono ‘trovate’ su Whatsapp a essere condivise in una catena praticamente infinita. Ma questa almeno è una questione da codice penale, su cui la autorità stanno indagando.

Oppure a quello che è accaduto all’ex-Ceo di Astronomer, Andy Byron, e alla sua responsabile delle risorse umane, Kristin Cabot. I due erano a un concerto dei Coldplay e sono stati ripresi da una kiss cam in atteggiamenti affettuosi. Sarebbe potuto finire lì, con una battuta del leader dei Coldplay, ma di nuovo la volontà di essere condivisi globalmente ha prevalso. Sottoposte infatti le immagini a una software di facial recognition, ecco apparire i loro nomi e i loro incarichi. E via allo ‘scandalo’. Tutti media del mondo ne hanno parlato, sui social la vicenda ha impazzato per giorni. Complice anche la posizione di Ceo e le sue retribuzioni, e la pruriginosità della ‘scoperta’: un’infedeltà coniugale come milioni di altre.

Un divieto che serve davvero a poco

La UE con il suo AI Act vieta esplicitamente alcuni usi del riconoscimento facciale e di altre tecnologie biometriche considerate una chiara minaccia per i diritti e le libertà fondamentali delle persone. Questo divieto è generale, sono previste solo eccezioni limitate e strettamente regolamentate per situazioni gravi, come la ricerca di persone scomparse o la prevenzione di attacchi terroristici, e solo con autorizzazione giudiziaria.

Ma a che cosa può servire questo divieto, quando chiunque può ricorrere online a software quali Pim Eyes o Face Check, o una delle decine di app esistenti, e pagando pochi dollari può ottenere le identità dei soggetti ripresi in tempo reale? La facial recognition è stata sdoganata, così come le fake news: due delle molte minacce che l’AI sta portando alla percezione della realtà ‘reale’. Presto non basteranno più foto, video, registrazioni, documenti per confermare che qualcosa è autentico. Come in un’infinita commedia (o tragedia) di Pirandello, quello che importerà sarà la ‘risonanza’, la ‘condivisione’, la ‘verosimiglianza’ di una notizia. Non la sua veridicità.

E grazie all’effetto ‘bolla’, ciascuno vedrà sempre più quello di cui è già convinto, in circolo vizioso senza fine e senza via d’uscita. Un futuro che vanamente si cerca di contrastare con norme e leggi che sono spesso superate dalle capacità della tecnologia già alla loro entrata in vigore.

Benvenuti nel nuovo mondo, quello del ‘uno vale uno’; ma per valere davvero, occorre essere un’infinità globale che ripeta ognuno la medesima affermazione, vera o falsa poco importa.

di Massimo Bolchi